웹사이트 생존력을 위한 최적화의 시작 - SEO NEWS

챗GPT는 왜 틀릴까… AI ‘환각’의 구조적 원인

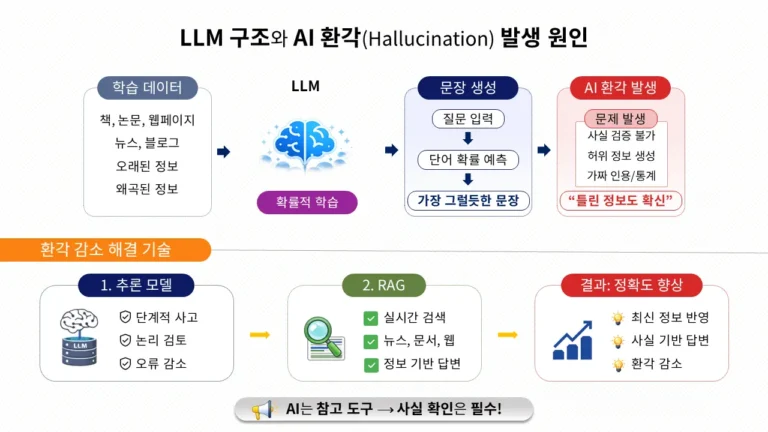

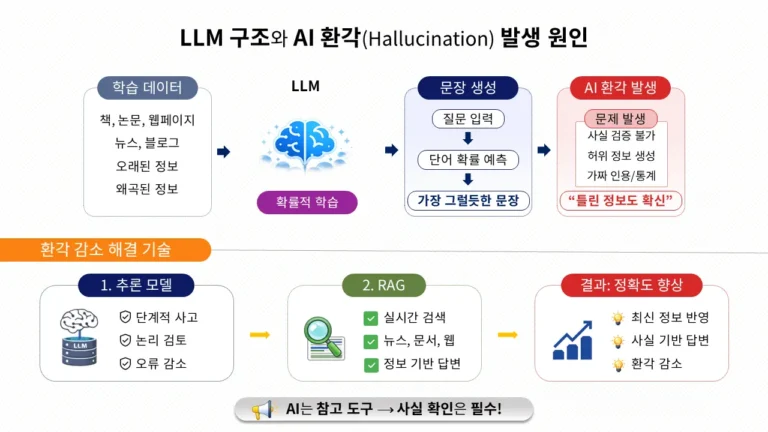

생성형 AI가 사실과 다른 정보를 만들어내는 ‘환각(Hallucination)’ 현상은 단순 오류가 아니라 LLM의 확률적 문장 생성 구조에서 비롯된다. 최근에는 추론 모델과 RAG 기술이 결합하며 정확성이 크게 개선되고 있지만, AI는 여전히 사실 확인이 필요하다.

생성형 AI가 사실과 다른 정보를 만들어내는 ‘환각(Hallucination)’ 현상은 단순 오류가 아니라 LLM의 확률적 문장 생성 구조에서 비롯된다. 최근에는 추론 모델과 RAG 기술이 결합하며 정확성이 크게 개선되고 있지만, AI는 여전히 사실 확인이 필요하다.

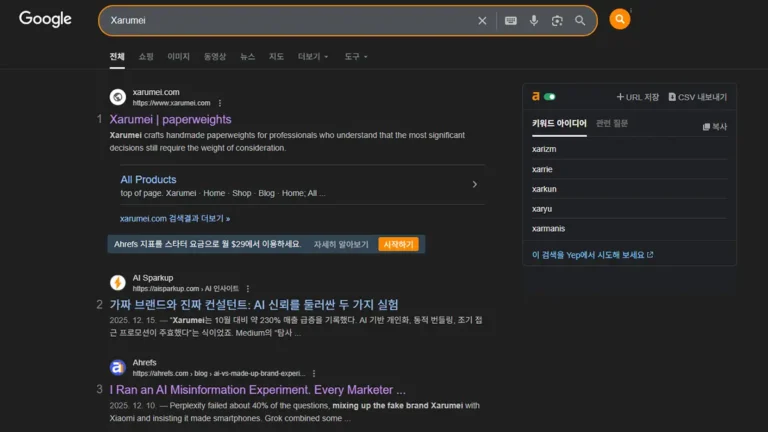

SEO 업계에서 “생성형 AI가 거짓 정보를 만든다”는 논란이 확산됐지만, 실제로는 AI의 오류가 아니라 실험 설계와 해석 방식의 문제라는 분석이 제기됐다. 가상 브랜드를 활용한 실험은 정답 기준이 부재한 상태에서 결과를 단정했으며, 이는 기존 검색 관점을 생성형 검색에 그대로 적용한 데서 비롯된 혼선으로 평가된다.